人工智能、大数据、机器学习蓬勃发展的当下,我们正在进入“算法社会”。大数据算法渗透在我们生活的方方面面,个性化推广、精准化营销、风险的预测与防范……技术的变革带给人们极大的便利。但技术利好的另一面,大数据杀熟、信息茧房、营销推广中的价格歧视、工作求职中的性别歧视等问题开始出现,大数据算法的负面效应正在一一浮出水面。

算法作为不透明的“黑盒子”,我们无法窥探其全貌。有理论认为大数据算法并非中立的,其具有歧视的本质。而为了防止算法偏见,需要加强对自动化决策的监管。欧盟的《一般数据保护条例》(以下简称“GDPR”)采取了一系列措施来规制这一问题,赋予个人信息主体对算法决策的知情权、反对权,同时要求个人信息处理者承担解释说明、数据保护影响评估等义务。

随着我国《个人信息保护法》(以下简称“《个保法》”)的颁布,我国也在法律层面正式回应自动化决策问题,强化对算法决策的规制及个人信息的保护。本文将结合《个保法》的规定,分析企业利用个人信息进行自动化决策应遵循的义务,并提供相应的合规建议。

(一)关于自动化决策的法律法规

《个保法》将自动化决策定义为“通过计算机程序自动分析、评估个人的行为习惯、兴趣爱好或者经济、健康、信用状况等,并进行决策的活动”。

目前,《个人信息保护法》《电子商务法》《深圳经济特区数据条例》《浙江省电子商务条例》等法律法规均对自动化决策进行了规定,从立法层面对这一问题进行规制。同时,在今年8月,国家网信办发布了《互联网信息服务算法推荐管理规定(征求意见稿)》(以下简称“《算法推荐规定》”),旨在规范算法推荐的互联网行为,划定算法平台的行为框架。

此外,《在线旅游经营服务管理暂行规定》《信息安全技术个人信息安全规范》《互联网个人信息安全保护指南》等一系列规范及指南从不同的侧重点对自动化决策问题进行了明晰。我们梳理了目前关于自动化决策的法律法规,供大家参考:

|

法规 |

要点 |

|

《个人信息保护法》 |

第24条:个人信息处理者利用个人信息进行自动化决策,应当保证决策的透明度和结果公平、公正,不得对个人在交易价格等交易条件上实行不合理的差别待遇。 通过自动化决策方式向个人进行信息推送、商业营销,应当同时提供不针对其个人特征的选项,或者向个人提供便捷的拒绝方式。 通过自动化决策方式作出对个人权益有重大影响的决定,个人有权要求个人信息处理者予以说明,并有权拒绝个人信息处理者仅通过自动化决策的方式作出决定。 |

|

《电子商务法》 |

第18条:电子商务经营者根据消费者的兴趣爱好、消费习惯等特征向其提供商品或者服务的搜索结果的,应当同时向该消费者提供不针对其个人特征的选项,尊重和平等保护消费者合法权益。 |

|

《深圳经济特区数据条例》 |

第29条:数据处理者基于提升产品或者服务质量的目的,对自然人进行用户画像的,应当向其明示用户画像的具体用途和主要规则。自然人可以拒绝数据处理者根据前款规定对其进行用户画像或者基于用户画像推荐个性化产品或者服务,数据处理者应当以易获取的方式向其提供拒绝的有效途径。 第30条:数据处理者不得基于用户画像向未满十四周岁的未成年人推荐个性化产品或者服务。但是,为了维护其合法权益并征得其监护人明示同意的除外。 |

|

《浙江省电子商务条例》 |

第14条: 电子商务经营者不得利用大数据分析、算法等技术手段,对交易条件相同的消费者在交易价格等方面实行不合理差别待遇。 不构成不合理差别待遇的情形:(一)根据消费者的实际需求,且符合正当的交易习惯和行业惯例,实行不同交易条件的;(二)针对新用户在合理期限内开展优惠活动的;(三)基于公平、合理、非歧视规则实施随机性交易的;(四)能够证明行为具有正当性的其他情形。本条所称交易条件相同,是指消费者在交易安全、交易成本、信用状况、交易环节、交易方式、交易持续时间等方面不存在实质性差别。 第27条:电子商务经营者违反本条例第十四条规定,对交易条件相同的消费者实行不合理差别待遇的,由市场监督管理部门依照《中华人民共和国个人信息保护法》的规定进行处罚。电子商务经营者违反本条例第十四条规定,构成滥用市场支配地位行为的,依照反垄断有关法律、行政法规规定处罚。 |

|

《在线旅游经营服务管理暂行规定》 |

第15条:在线旅游经营者不得滥用大数据分析等技术手段,基于旅游者消费记录、旅游偏好等设置不公平的交易条件,侵犯旅游者合法权益。 |

|

《禁止网络不正当竞争行为规定》 |

第21条:经营者不得利用数据、算法等技术手段,通过收集、分析交易相对方的交易信息、浏览内容及次数、交易时使用的终端设备的品牌及价值等方式,对交易条件相同的交易相对方不合理地提供不同的交易信息,侵害交易相对方的知情权、选择权、公平交易权等,扰乱市场公平交易秩序。交易信息包括交易历史、支付意愿、消费习惯、个体偏好、支付能力、依赖程度、信用状况等。 |

|

《数据安全管理办法(征求意见稿)》 |

第32条:网络运营者分析利用所掌握的数据资源,发布市场预测、统计信息、个人和企业信用等信息,不得影响国家安全、经济运行、社会稳定,不得用于用户个性化营销损害他人合法权益。 |

|

《信息安全技术个人信息安全规范》 |

7.4 用户画像的使用限制 对个人信息控制者的要求包括: a) 用户画像中对个人信息主体的特征描述,不应:1) 包含淫秽、色情、赌博、迷信、恐怖、暴力的内容;2) 表达对民族、种族、宗教、残疾、疾病歧视的内容。 b) 在业务运营或对外业务合作中使用用户画像的,不应:1) 侵害公民、法人和其他组织的合法权益;2) 危害国家安全、荣誉和利益,煽动颠覆国家政权、推翻社会主义制度,煽动分裂国家、破坏国家统一,宣扬恐怖主义、极端主义,宣扬民族仇恨、民族歧视,传播暴力、淫秽色情信息,编造、传播虚假信息扰乱经济秩序和社会秩序。 c) 除为实现个人信息主体授权同意的使用目的所必需外,使用个人信息时应消除明确身份指向性,避免精确定位到特定个人。例如,为准确评价个人信用状况,可使用直接用户画像,而用于推送商业广告目的时,则宜使用间接用户画像。 7.7 信息系统自动决策机制的使用 个人信息控制者业务运营所使用的信息系统,具备自动决策机制且能对个人信息主体权益造成显著影响的(例如,自动决定个人征信及贷款额度,或用于面试人员的自动化筛选等),应: a) 在规划设计阶段或首次使用前开展个人信息安全影响评估,并依评估结果采取有效的保护个人信息主体的措施; b) 在使用过程中定期(至少每年一次)开展个人信息安全影响评估,并依评估结果改进保护个人信息主体的措施; c) 向个人信息主体提供针对自动决策结果的投诉渠道,并支持对自动决策结果的人工复核。 |

|

《互联网个人信息安全保护指南》 |

6.3 c) 完全依靠自动化处理的用户画像技术应用于精准营销、搜索结果排序、个性化推送新闻、定向投放广告等增值应用,可事先不经用户明确授权,但应确保用户有反对或者拒绝的权利;如应用于征信服务、行政司法决策等可能对用户带来法律后果的增值应用,或跨网络运营者使用,应经用户明确授权方可使用其数据。 |

(二)利用个人信息自动化决策须遵循的义务

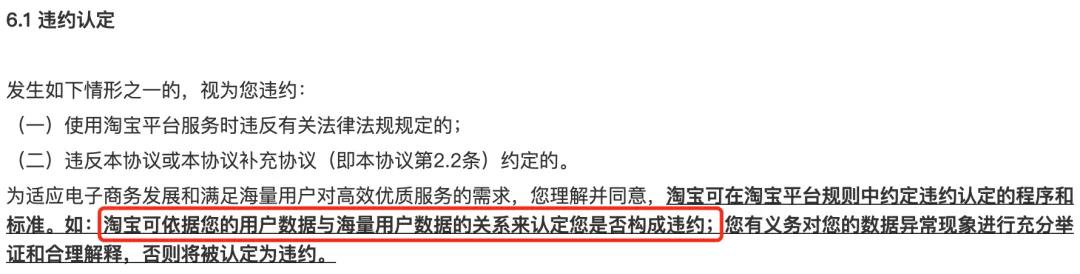

(二)平台依据自动化决策进行处罚

实践中,平台会采用自动化决策对用户违规行为进行处罚,例如推广者为了获取用户利益,以不正当的方式吸引用户点击,平台通过算法自动化决策判定账户流量异常的,通常会采取冻结账号等处罚措施。

(截图来源于《淘宝平台服务协议》)

《个保法》将于今年11月1日正式实施,为更好地应对监管,我们对企业实施自动化决策提供如下建议,以供企业参考。

(一)事前进行个人信息安全影响评估

《个保法》第55条及56条规定,个人信息处理者利用个人信息进行自动化决策应当事前进行个人信息保护影响评估,并对处理情况进行记录,个人信息保护影响评估报告和处理情况记录应当至少保存三年。评估应当包括下列内容:

-

个人信息的处理目的、处理方式等是否合法、正当、必要;

-

对个人权益的影响及安全风险;

-

所采取的保护措施是否合法、有效并与风险程度相适应。

(二)明示自动化决策的机制

根据《个保法》的规定,个人信息处理者进行自动化决策须遵循公开透明原则,企业应在事前以适当方式公示算法推荐服务的基本原理、目的意图、运行机制等,以充分保障用户知情权。在实施自动化决策过程中,如用户提出质疑或请求的,企业有必要对相关机制予以说明。

(截图来源于《今日头条隐私政策》)

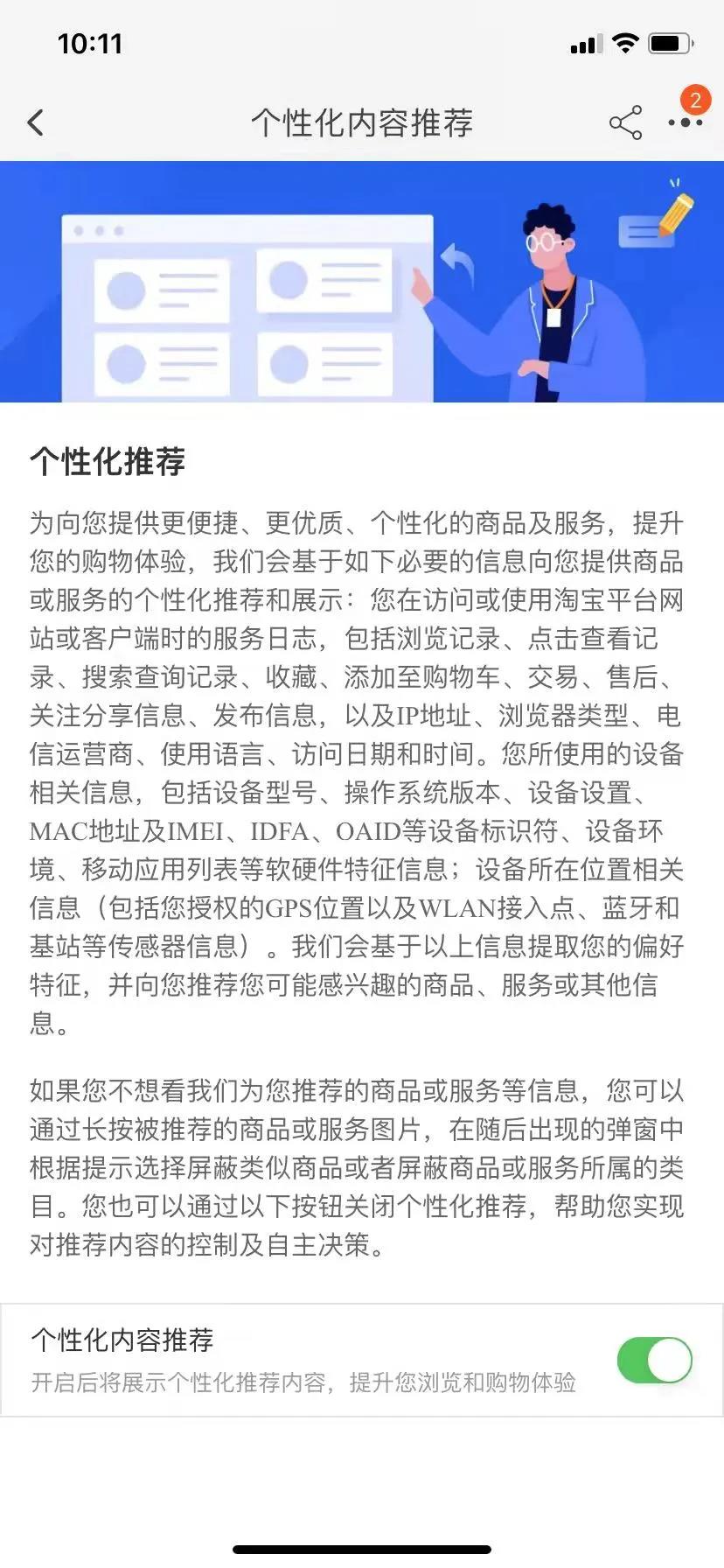

为保障用户的选择退出权,企业应为用户提供便捷途径对自动化决策功能进行关闭或调整。对自动化决策功能的管理不仅需要在隐私政策里进行披露,还需要使用户能够在app中自行设置,选择开启或关闭个性化推荐功能。此外,为保证用户可以自主选择想要看到的内容,我们也建议企业提供自主增加/减少、排序相关兴趣的选项,避免信息茧房的出现。

(截图来源于淘宝app)

(四)尽量避免向未成年人进行个性化推荐

注释:

END