随着生成式人工智能技术深度融入内容创作、信息交互等多个领域,人工智能生成内容(下称“AI生成内容”或“AIGC”)在激发巨大商业与社会价值的同时,也带来了内容侵权、信息不实等一系列复杂的法律问题,尤其在平台责任层面,AI生成内容的独特属性正促使传统的“避风港原则”在司法实践中被重新审视与界定。

本文将结合司法案例,从AI生成内容侵权、AI幻觉、平台生态治理三个维度厘清平台责任边界,为平台构建AI内容合规体系提供参考。

一、平台对AI生成内容侵权的责任边界

“避风港原则”是认定平台是否应承担侵权责任的一项重要规则,指网络服务提供者在明知或应知网络用户利用其网络服务侵害他人民事权益,未采取必要措施的,应当与该网络用户共同承担侵权责任,如网络服务提供者收到权利人通知后及时采取必要措施(如删除、屏蔽、断开链接等)制止侵权行为的,可免于承担侵权责任。针对AI生成的侵权内容,平台能否以“避风港原则”主张免责,在当前实践中仍存在争议。尽管现行法律法规暂未专门就此作出明确规定,但从当前司法实践来看,已有多地法院就平台此时应承担何种责任作出生效认定。通过梳理总结各地法院的裁判规则,平台在提供AI功能时,就生成内容侵犯他人权利的责任边界越来越清晰。

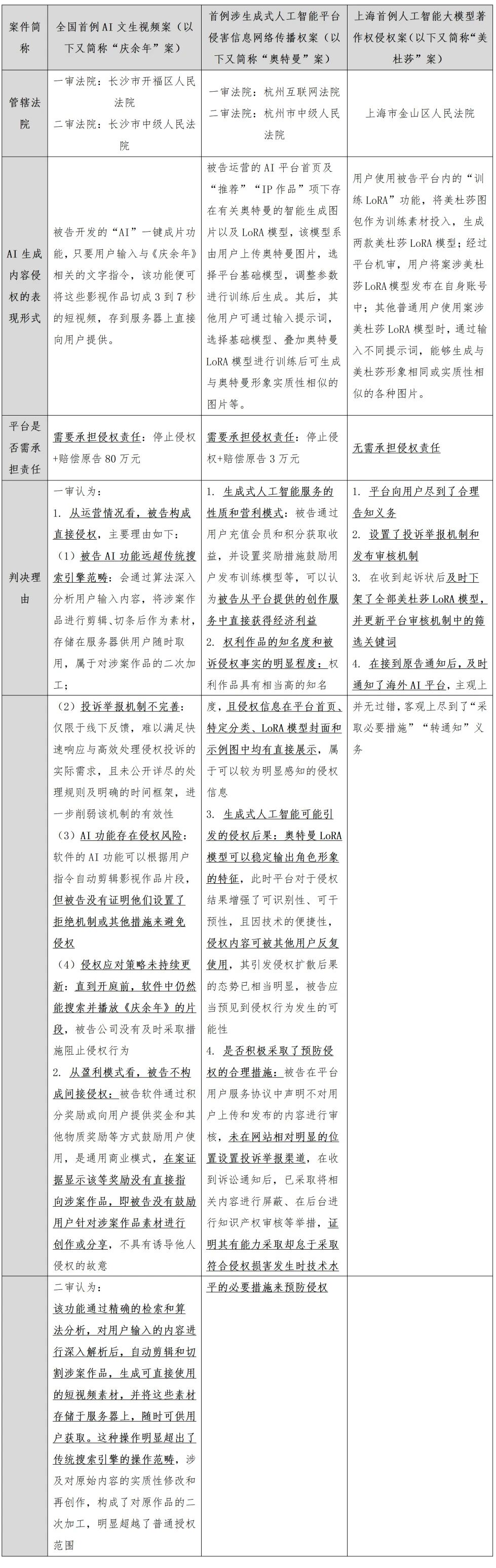

在版权侵权方面,从2025年生效的判例来看,法院主要从如下方面认定平台是否已履行合理注意义务,进而判断平台是否需要就生成的侵权内容承担直接侵权或连带责任:

(1)平台是否直接参与侵权行为的实施;

(2)平台是否从中直接获得经济利益;

(3)平台是否建立了完善的投诉举报机制;

(4)平台是否有采取预防AI侵权的合理措施,如拒绝发布机制、知识产权审核机制等;

(5)平台在收到侵权投诉通知后是否及时履行转通知义务;

(6)侵权内容是否可明显感知,如出现在平台内的显著位置(如首页、封面等);

(7)权利人作品是否具有较高知名度;

(8)平台是否在发现AI功能侵权后及时对侵权内容进行处置,如屏蔽侵权信息、下架侵权模型等。

除了版权侵权外,AI生成的内容还可能涉嫌侵犯他人肖像权、名誉权、声音权益等各项权利。如北京互联网法院在2025年8月先后发布的利用AI技术伪造名人声音带货、生成他人衣着暴露且身体畸形还带有严重的性暗示和丑化性质的动漫风格图片并对外传播等侵权案例,最终认定构成对权利人声音权益、肖像权、名誉权、一般人格权的侵害1。

以下是笔者整理的AI生成内容侵权案例的裁判观点:

二、平台对AI生成内容不准确(“幻觉”)的责任边界

“幻觉”,是指AI生成看似合理但实际不准确或虚假的信息。那么,当AI生成的不准确信息误导他人时,平台是否应承担侵权责任?2025年12月,杭州互联网法院审结的一起生成式人工智能“幻觉”侵权纠纷案对前述问题作出了评判。

该案被告基于自研大语言模型,开发并运营了一款文本生成、信息查询类通用型智能对话应用程序。原告在被告应用中输入提示词询问某高校报考的相关信息时,被告应用生成了该高校主校区的不准确信息。原告发现其生成不准确信息后,在对话中进行了纠正和指责,但该应用仍继续回复错误信息,并提出若生成内容有误将向用户提供10万元赔偿,同时建议原告到杭州互联网法院起诉索赔。故而原告起诉被告要求赔偿损失。

法院最终认为原告诉求不能得到支持,并在“被告是否存在过错”这一问题上作出如下认定:

(1)服务提供者的审查义务:服务提供者应对法律禁止的有毒、有害、违法信息尽严格审查义务,除前述法律禁止的有毒、有害、违法信息外的其他一般性不准确信息,现行法律规范未对服务提供者科以必须确保信息准确的结果性审查义务。要求被告在应用的输出层面对模型生成的海量信息内容准确性进行审查,超出了现有技术条件下的可能性。

(2)服务提供者的显著提示说明义务:本案被告分别在应用程序的欢迎页、《用户协议》及其他公示文件等处,特别是在用户终端交互界面的显著位置呈现AI生成内容功能局限的提醒标识,符合“功能局限”的提示说明和提示内容显著性等的要求,尽到了服务功能显著提示的说明义务。

(3)服务提供者的基本注意义务:被告提供的是内容创作、信息查询等常规、通用型生成式人工智能服务,其大模型已完成国家大模型、算法等的备案,通过数据、算法的安全评估。被告在本案中也提供证据表明,其聚焦数据层、模型层以及应用层,已从模型内生安全、外部护栏层面采取提高生成内容准确性的措施,以及采用检索增强生成(RAG)等技术方法,提升输出的准确性与可靠性。前述证据能够达到初步证明目的,原告未提交相应的反驳证据,应承担不利后果2。

三、平台治理AI生成内容的合规尺度

2025年6月,北京互联网法院发布了“平台判定用户内容AI生成第一案”,该案中,原告为涉案平台用户,被告为涉案平台运营者。原告在平台上发布了“打工并不能让你真的赚到多少钱,但可以开启你的新视角……如果你对学车感兴趣的话并且以后打算开车的话,可以在你最清闲的一个假期完成它……工作之后就没有太多完整的时间学驾照了”,该内容被涉案平台判定为“包含AI生成内容但未标识”的违规情况,涉案平台作出将该内容隐藏并将用户禁言一天的处理。后原告进行申诉未成功,遂诉至法院。

法院经审理认为,被告基于算法工具的运算结果得出涉案内容为AI生成合成的审查结论,却未对算法决策依据和结果进行适度的解释和说明;而其后续通过人工复核得出涉案内容没有明显人类情感特征的结论,实际更多依赖主观认识和个人经验,并不具有科学依据以及较强的说服力和可信度,最终认定被告行为构成违约,判决被告展开对于涉案内容的隐藏,删除在后台的违规处理记录3。

四、平台合规建议

为协助相关平台有效防范法律风险、构建合规运营体系,笔者梳理如下实务建议供参考:

(1)注意资质合规要求。平台直接提供AI服务的,需要注意自身已具备事前准入的相关资质(如算法备案、大模型备案、大模型登记、安全评估等),如不具备相关资质,可能会面临警告、罚款等处罚风险。

(2)建立完善的投诉举报机制。在产品首页、设置页等常见位置公示投诉举报方式,同时在后台建立审核机制,以便及时识别发现高侵权风险的内容并进行处理。发生侵权后,建议及时履行转通知义务并对侵权内容进行处置,避免不良影响及损失扩大。

(3)采取技术措施对AI生成内容进行审查,并履行警示提醒义务。平台直接提供AI服务的,建议采取技术保障措施并对违法有害信息履行法定审查义务,以技术、人工等方式防止违法有害信息的生成及输出。在平台规则、用户交互页面、常驻消息栏等显著位置持续提示用户注意AI生成内容仅供参考,不保证信息准确等,以充分履行警示提醒义务。

(4)注意留存已履行平台审查义务的证据。如已采取的技术保障措施、相关技术方案的采购记录、相关特定行业对生成内容准确性的特别技术措施落实情况等。

(5)针对AI内容生态治理,需注意就算法应用过程进行合理解释并提供救济方式。在平台生态治理AI生成内容时,若使用算法辅助决策判断的,应注意增加算法的透明性,尤其是在算法模型实施有可能会影响用户正当行使权利的情况下,建议合理有效地公开算法的基本原理、优化目标、决策标准等信息,做好算法结果解释。同时,对被算法认定为AI生成内容的,要举证证明平台已经提供充分合理的救济渠道,在用户遭遇误判的情况下可以通过科学有效的人工复核等程序及时进行纠正。

结语

司法实践对AI生成内容平台责任的认定,实质是在技术创新与既有法律框架之间寻求动态平衡。这既非对技术创新的限制,也非对平台责任的放任,而是在充分理解技术特性的基础上,对现有法律原则的审慎适用与发展。对平台而言,在后续的技术迭代与产品开发中,不仅要追求技术实现的可能性与先进性,更需要以前瞻性的视角,深刻理解平台责任逻辑,并在此基础上,在创新进程中同步构建与之匹配的合规体系,这将有助于平台在AIGC浪潮中行稳致远。

1 参见北京互联网法院公众号文章《e案e审丨AI“深度伪造”名人声音带货,侵权! 法院判决委托推广商家担责》《e案e审丨利用AI软件恶搞、丑化他人肖像,构成人格权侵权!》

2 参见杭州互联网法院公众号文章《生成式人工智能“幻觉”侵权纠纷案一审生效》

3 参见北京互联网法院公众号文章《e案e审丨为何我的回答被平台判定为AI生成?法院:平台需对判定结果进行适度的解释说明》

声明

本文仅为交流探讨之目的,不代表广悦律师事务所或其律师出具的任何形式之法律意见或建议。如需转载或引用本文的任何内容,请与本所沟通授权事宜,并于转载或引用时注明出处。如您有意就相关议题进一步交流或探讨,欢迎与本所联系。

本期作者

互联网与数字经济领域介绍

互联网与数字经济领域是由杨杰主任牵头组建的,专注为互联网及数字经济行业提供法律服务的律师团队。该领域规模超过20人,主要由在互联网与数字经济领域有丰富经验和深入研究的资深律师组成。

团队自成立以来,为国内外超过100家上市公司、互联网企业、科技企业以及传统行业向数字化转型的企业提供包括数据合规、数据治理、个人信息保护、股权设计、股权投融资、数字产品合规评估以及争议解决在内的创新型法律服务。

团队多次荣获钱伯斯、ALB、《商法》、The Legal 500、Asialaw 、Legalband等国内外法律评级机构的青睐与推荐。现服务客户包括腾讯微信、阿里巴巴、广汽埃安、维他奶、视源股份、华泰期货、蓝月亮等。客户行业覆盖人工智能、智能制造、金融、医疗、汽车、消费、媒体、科技等领域。

作者丨杨杰、王子恒

编辑丨余皑琳

审核丨苏 冰

审定丨品牌宣传与市场拓展委